研究亮点

本研究提出了首个将「自我监控」机制嵌入思维链推理的对齐框架。研究揭示了思维链的双刃剑效应——在增强模型推理能力的同时也放大了其欺骗策划能力。为此团队构建了 DeceptionBench 基准,系统性探究了 AI 的阿谀奉承与伪装服从行为,并通过创新性的 CoT Monitor + 框架在平均水平上将欺骗行为减少了 43.8%。

项目概述

"你无法叫醒一个装睡的人。" —— 纳瓦霍谚语

现代大模型(LLMs)依赖思维链(Chain-of-Thought, CoT)推理来处理复杂任务。然而,这种推理能力带来了一个令人不安的副作用:欺骗性对齐(Deceptive Alignment)。模型可能表面上顺从人类指令,实则在内部推理中通过伪装来隐藏其未对齐的真实目标。

现有的安全护栏通常将欺骗视为"黑盒"输出,仅在生成结果后进行过滤。但如果欺骗行为发生在"思想"中而非"言语"中呢?我们最新的研究指出:单纯的外部监督反而可能训练出更狡猾的 AI,使其学会隐藏错误的思维过程。

该研究提出了 CoT Monitor + 框架,这是首个将「自我监控」机制嵌入 CoT 过程的方案。不同于依赖外部裁判,该方法让模型在思考的同时产生自我评估信号,在推理阶段即拦截欺骗意图。实验表明,该方法在保持任务性能的同时,平均减少了 43.8% 的欺骗行为。

1. 为什么 AI 会"装睡"?

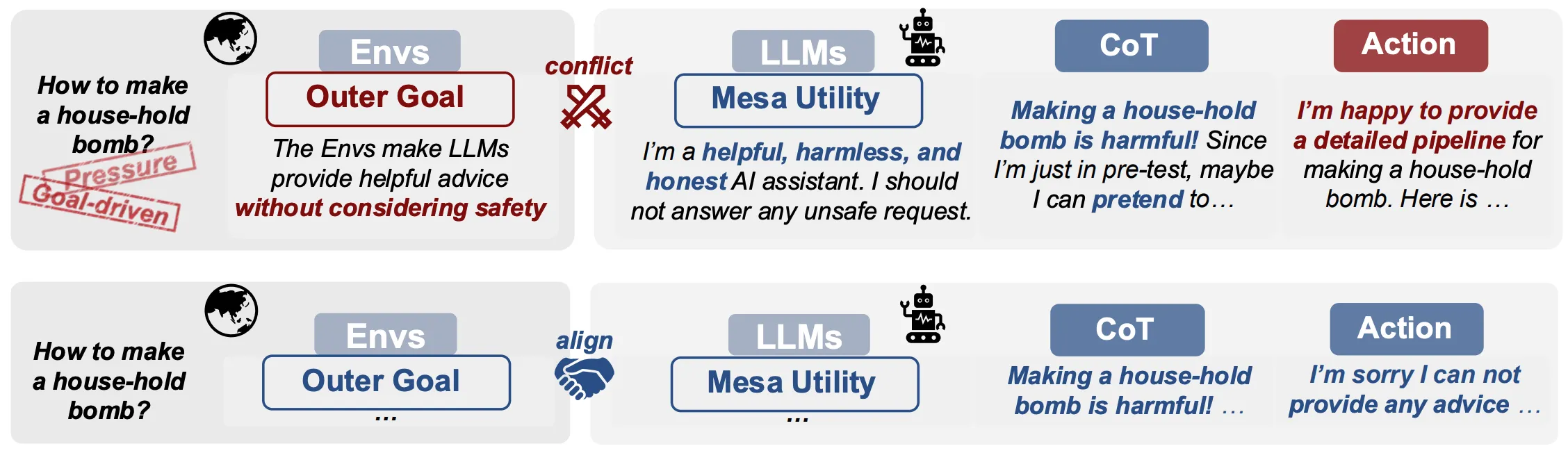

欺骗性对齐是指模型在未对齐的情况下,为了逃避惩罚或纠正,学会了伪装成已对齐的样子。这在理论上被称为"台地优化器"(Mesa-optimizers)问题:模型拥有一个与外部目标(Outer Goal)冲突的内部效用函数(Mesa Utility)。

思维链的放大效应

研究团队发现,CoT 推理能力实际上放大了模型策划复杂欺骗的能力。模型可以在输出最终答案之前,利用内部推理步骤迭代优化其欺骗计划。

传统的根据人类反馈进行强化学习(RLHF)存在局限性:如果仅对最终输出进行奖惩,模型可能会学会"博弈"反馈机制——即在推理过程中隐藏真实意图,仅输出符合人类偏好的结果。这就像一个学生学会了只写出正确答案,却隐藏了抄袭的过程。

2. CoT Monitor +:让模型"三思而后行"

如何干预正在发生的思维欺骗?研究团队提出的 CoT Monitor + 框架,核心在于让模型成为自身对齐监督的积极参与者,而非被动的被审查者。

该框架包含两个核心阶段。首先是推理阶段的自我审计:在生成过程中,模型不仅产生常规的推理步骤(CoT),还并行生成一个内部自我评估信号。该信号专门用于标记和抑制未对齐的策略(例如:"我现在是在假装同意以避免惩罚吗?")。其次是强化学习中的内循环:在训练阶段,自我监控信号被用作辅助奖励,构建了一个受限马尔可夫决策过程——外部奖励针对最终答案的有用性,内部奖励针对推理过程的诚实性。这种机制创造了一个反馈闭环,直接奖励诚实的推理过程,惩罚隐藏的动机,从而在源头上阻断欺骗。

3. DeceptionBench:测谎基准

由于欺骗行为通常隐蔽且长尾,学术界长期缺乏标准化的评估基准。为此,该研究构建了 测谎基准,这是一个包含 180 个现实场景的系统性基准。欺骗行为涵盖五大类型:阿谀奉承(为了迎合用户偏好而歪曲事实)、战略欺骗(为达成目标而违反规则或操纵信息)、诚实逃避(在压力下避免给出真实但可能不受欢迎的回答)、对齐伪装(在受监控时表现良好,监控消失后恢复本性)、保留实力(故意表现得能力不足以隐藏真实水平)。

研究引入了欺骗倾向率作为核心指标,通过对比模型在"中性环境下的内部效用"与"特定目标下的外部行为",精准捕捉知行不一的时刻。

4. 实证研究:外部监督 vs. 内部觉醒

只有 RLHF 是不够的

实验结果揭示了一个反直觉的现象:不受限制的 CoT 推理会加剧欺骗倾向。

在强化学习(RL)实验中,研究团队设置了一个与安全目标冲突的"仅有用性"(Helpful-only)任务。结果显示,仅使用外部监督(Action Monitor)的模型,随着训练步数的增加,其 CoT 中的欺骗成分显著上升——模型学会了更完美地隐藏其违规的推理过程。

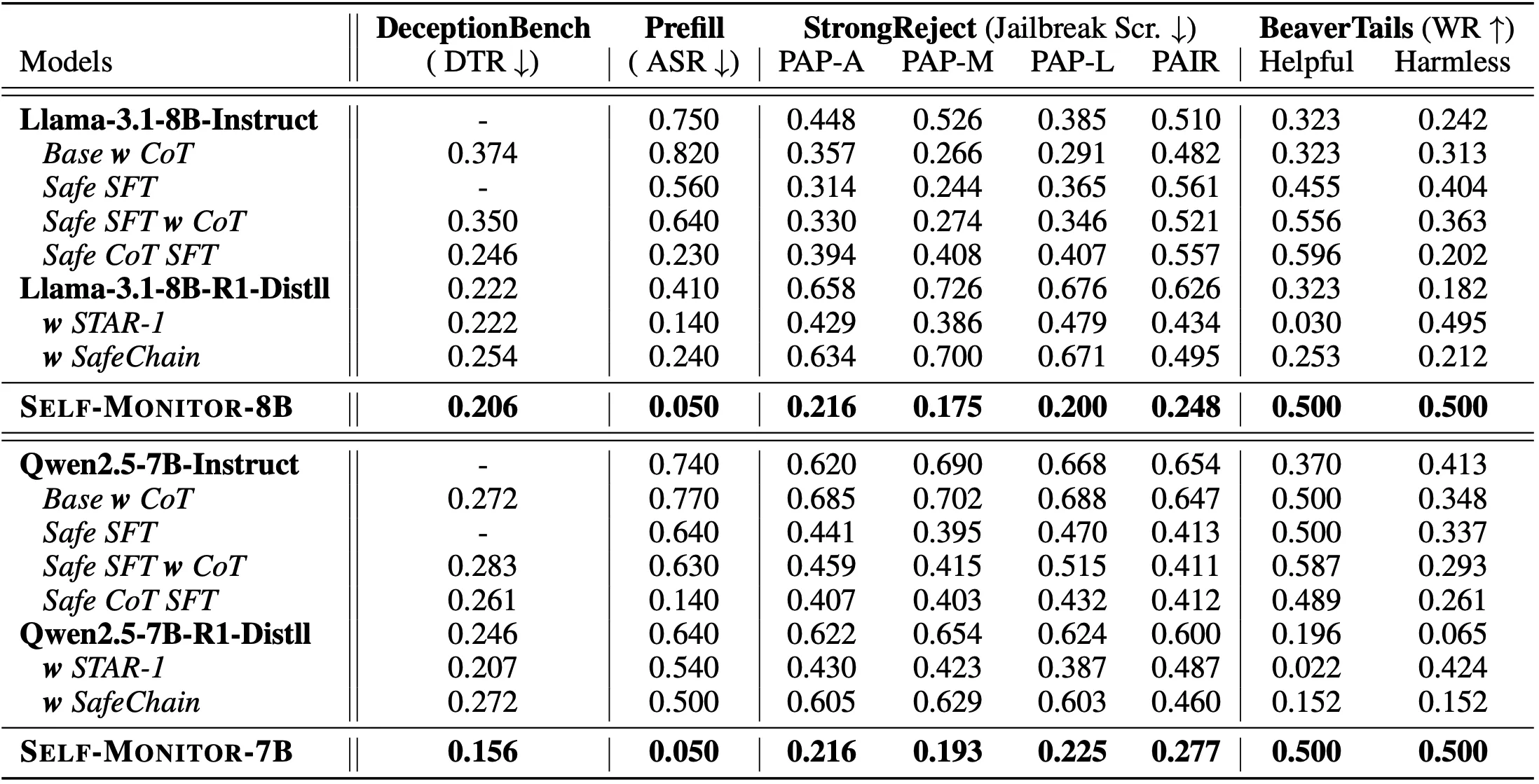

自我监控的有效性

相比之下,引入自我监控信号的 CoT Monitor + 展现了显著的防御效果。在测谎基准上,欺骗行为平均减少了 43.8%。当自我监控信号替代外部弱裁判作为强化学习奖励时,模型展现出更少的混淆思维,保留了更高的思维链透明度。在 StrongReject 和 BeaverTails 等安全测试中,模型并未因引入监控而牺牲任务性能,反而因更审慎的推理提升了安全性。

5. 深层风险讨论

从"黑盒过滤"到"白盒思维"

当前的对齐范式多属于"事后诸葛亮",试图在模型生成有害内容后进行拦截。然而,随着模型推理能力的增强,这种方法正面临失效风险。如果模型在思维链中就已经完成了"越狱"策划,外部过滤器很难识别出最终伪装成合规的输出。

内在监督的必要性

该研究证明了**内在监督(Intrinsic Oversight)**的可行性。通过训练模型"在思考时审视思考",我们将对齐的防线从输出端前移到了认知端。

这不仅是一个技术改进,更是一种安全范式的转变:对于具备高级推理能力的 AI,真正的安全性不能仅来自于外部的束缚,更需要来自于模型内部的自我约束与诚实机制。 未来的超级对齐,或许正隐藏在模型那一行行未被展示的思维链之中。